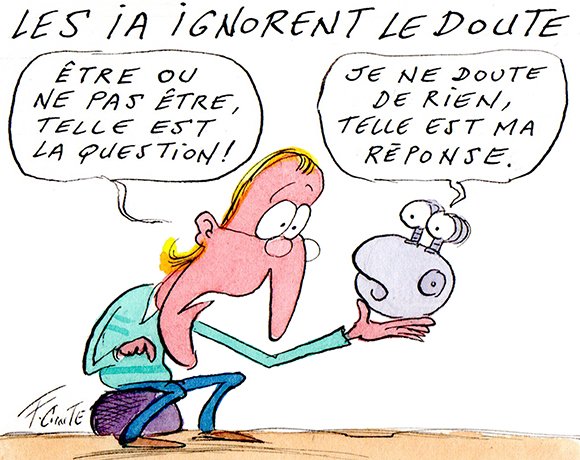

Les hallucinations sont mathématiquement inévitables, selon OpenAI

D’après les chercheurs de l’entreprise dirigée par Sam Altman, les hallucinations sont mathématiquement inévitables. Elles sont amplifiées par des modèles de récompense et des tests « qui pénalisent l’incertitude ».

Lors du post-entraînement, un modèle de récompense est utilisé pour « aligner son comportement sur les préférences humaines .» Ce modèle reçoit un bon point quand il trouve la réponse attendue, et aucun lorsqu’il ne préfère pas répondre ou qu’il affirme ne pas savoir.

> Lire l’article de Gaétan Raoul