IBM

Les mainframes exécuteront bientôt les binaires ARM

IBM se rapproche de la société qui développe le jeu d’instruction des processeurs ARM dans le but de faire fonctionner les applications d’IA modernes sur ses machines critiques. Cela suggère qu’il y aura donc des applications d’IA qui fonctionneront seulement sur architecture ARM.

IBM annonce avoir noué un partenariat avec la société Arm pour implémenter dans ses mainframes le jeu d’instruction des processeurs ARM. Selon le communiqué, il s’agit essentiellement de permettre aux applications publiées dans le domaine de l’IA de s’exécuter sur des machines réputées les plus fiables, les plus sécurisées et les plus élastiques.

IBM cite plus précisément trois enjeux. D’abord, permettre aux mainframes de virtualiser des machines ARM. Ensuite, apporter aux entreprises une solution pour exécuter leurs traitements modernes sur des environnements critiques et souverains. Enfin, favoriser l’émergence d’un écosystème où éditeurs et prestataires pourraient commercialiser de nouveaux services multi-plateformes.

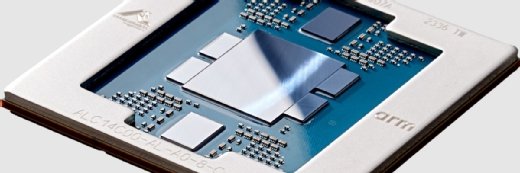

À ce stade, les deux entreprises évoquent une « architecture double » sans pour autant préciser ni la date ni la forme que prendra cette implémentation. Celle-ci peut aller d’un circuit capable d’exécuter du code ARM au sein de la prochaine génération de processeurs Telum d’IBM, à la présence d’une carte équipée d’un processeur ARM dans ses mainframes.

Pour mémoire, Arm est une société d’ingénierie qui conçoit l’architecture ARM et en revend la licence à de nombreux fabricants de processeurs. Arm, dont le siège est situé en Angleterre et dont une bonne partie des équipes de R&D est basée à Grenoble, est une filiale du conglomérat japonais SoftBank Group. Depuis novembre dernier, celui-ci détient aussi le fabricant de processeurs ARM Ampere Computing.

IBM, de son côté, fabrique lui-même les processeurs et les accélérateurs de ses mainframes Z et de ses serveurs Unix Power. Il a aussi développé des processeurs dédiés à l’exécution des codes Linux (puces IFL) et d’autres spécifiquement conçus pour traiter les requêtes SQL (puces zIIP).

Les applications d’IA, programmées dans des langages de haut niveau, fonctionnent pour l’heure indifféremment, quel que soit le processeur hôte. Seuls les GPU sont spécifiquement adressés par les bibliothèques d’accélération.

Toutefois, Nvidia pousse désormais son processeur ARM Vera dans les clusters d’IA. Et d’autres processeurs ARM exécutent des applicatifs liés à l’IA chez tous les hyperscalers américains. Ce faisceau de concordances technologiques pourrait déboucher à terme sur une situation où il deviendrait souhaitable d’importer sur un mainframe des agents qui n’existent qu’en version compilée pour processeurs ARM.

La prolifération de binaires uniquement compilés pour processeurs ARM est d’autant plus probable dans les applications d’IA que celles-ci consomment beaucoup d’énergie. Or, c’est justement le défaut que pondère l’architecture ARM. Elle y parvient grâce à un jeu d’instructions constitué d’opcodes plus simples, qui réduisent drastiquement le nombre de transistors sollicités lors de certaines opérations, comparativement aux processeurs x86.