Qu'est-ce que la traduction d'image à image ?

La traduction d'image à image est une technique d'intelligence artificielle (IA) générative qui traduit une image source en une image cible tout en préservant certaines propriétés visuelles de l'image originale. Cette technologie utilise des techniques d'apprentissage automatique et d'apprentissage profond telles que les réseaux antagonistes génératifs (GAN), les réseaux antagonistes conditionnels, ou cGAN, et les réseaux neuronaux convolutifs (CNN) pour apprendre des fonctions de mappage complexes entre les images d'entrée et de sortie.

La traduction d'image à image permet de convertir des images d'une forme à une autre tout en conservant les caractéristiques essentielles. L'objectif est d'apprendre une correspondance entre les deux domaines, puis de générer des images réalistes dans le style choisi par le concepteur. Cette approche permet d'effectuer des tâches telles que le transfert de style, la colorisation et la super-résolution, une technique qui améliore la résolution d'une image.

La technologie image-image englobe un ensemble varié d'applications dans les domaines de l'art, de l'engagement dans l'image, de l'augmentation des données et de la vision par ordinateur, également connue sous le nom de vision artificielle. Par exemple, la traduction d'image à image permet aux photographes de transformer une photo de jour en photo de nuit, de convertir une image satellite en carte et d'améliorer les images médicales pour permettre des diagnostics plus précis.

Comment fonctionne la traduction d'image à image ?

Les systèmes de traitement d'images utilisant la traduction d'image à image nécessitent les étapes de base suivantes :

- Définir les domaines d'images. Le processus commence par la définition des domaines d'images, qui représentent les types d'images d'entrée et de sortie que le système traitera. Ces domaines peuvent inclure diverses catégories telles que le transfert de style, la super-résolution et la modélisation sémantique.

- Entraîner le système. Un ensemble de données contenant des exemples appariés d'images d'entrée et d'images cibles - parfois appelées images cibles de vérité terrain - est utilisé pour entraîner le système afin qu'il puisse apprendre la correspondance nécessaire entre les deux domaines.

- Combiner le générateur et le discriminateur. Une fois entraîné, un GAN est utilisé pour combiner les réseaux générateur et discriminateur. Le réseau générateur reçoit une image d'entrée du domaine source et génère une image de sortie qui appartient au domaine cible. Pendant ce temps, le réseau discriminateur apprend à distinguer les images réelles du domaine cible ainsi que les images synthétisées produites par le générateur. Une fonction de perte est utilisée pour mesurer la différence entre la sortie générée et l'image cible de référence.

Un aspect essentiel de la traduction d'image à image consiste à s'assurer que le modèle se généralise bien en réponse à des scénarios inédits ou non supervisés. La cohérence des cycles et l'apprentissage non supervisé permettent de s'assurer que si une image est traduite d'un domaine à un autre et inversement, elle retrouve sa forme d'origine. Les architectures d'apprentissage en profondeur, telles que U-Net et CNN, sont également couramment utilisées car elles peuvent capturer des relations spatiales complexes dans les images. Dans le processus de formation, des algorithmes de normalisation et d'optimisation des lots sont utilisés pour stabiliser et accélérer la convergence.

Traduction supervisée ou non supervisée d'une image à l'autre

Les deux principales approches de la traduction d'image à image sont l'apprentissage supervisé et l'apprentissage non supervisé.

Apprentissage supervisé

Les méthodes supervisées s'appuient sur des données d'apprentissage appariées, où chaque image d'entrée a une image cible correspondante. Grâce à cette approche, le système d'image généré apprend la correspondance directe requise entre les deux domaines. Toutefois, l'obtention de données appariées peut s'avérer difficile et longue, en particulier lorsqu'il s'agit de transformer des images complexes.

Apprentissage non supervisé

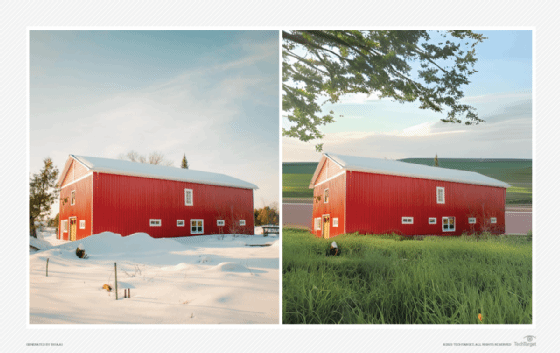

Les méthodes non supervisées s'attaquent au problème de la traduction d'image à image sans exemples d'apprentissage appariés. L'une des principales approches non supervisées est CycleGAN, qui introduit le concept de cohérence des cycles. Il s'agit de deux mappings : du domaine source au domaine cible et vice versa. CycleGAN garantit que le domaine cible est similaire à l'image source originale.

Modèles d'IA pour la traduction d'images

La traduction d'image à image et l'IA générative en général sont vantées pour leur rentabilité, mais elles sont également critiquées pour leur manque de créativité. Il est essentiel d'étudier les différents modèles d'IA qui ont été développés pour traiter les tâches de traduction d'image à image, car chacun d'entre eux présente des avantages et des inconvénients qui lui sont propres. Des groupes de recherche tels que Gartner invitent également les utilisateurs et les développeurs d'IA générative à rechercher la confiance et la transparence lors du choix et de la conception des modèles.

Parmi les modèles les plus populaires, on peut citer les suivants :

- StarGAN. Il s'agit d'une approche évolutive de traduction d'images à modèle unique, conçue pour effectuer la traduction d'images dans plusieurs domaines. Contrairement aux méthodes traditionnelles qui nécessitent la construction de modèles distincts pour chaque paire de domaines d'images, StarGAN consolide le processus de traduction dans un cadre unifié. Ce modèle introduit une nouvelle architecture qui peut apprendre efficacement les correspondances entre les différents domaines d'images, permettant ainsi une traduction d'images polyvalente et efficace.

- CycleGAN. Il s'agit d'un modèle de traduction d'image à image non supervisé qui a fait l'objet d'une attention particulière de la part de la communauté des chercheurs. Il relève le défi des données d'entraînement avec des images non appariées en utilisant le concept de cohérence du cycle. En incorporant la perte de cohérence du cycle, qui garantit que l'image traduite peut être ramenée à l'image source originale, CycleGAN obtient des résultats remarquables dans diverses transformations d'images sans avoir besoin d'exemples appariés.

- Pix2Pix GAN. Ce GAN est un modèle génératif conditionnel qui apprend une correspondance entre une image d'entrée et un vecteur de bruit vers l'image de sortie plutôt qu'à partir d'un bruit aléatoire. Cette approche conditionnelle permet des traductions plus contrôlées et plus précises. Le modèle utilise une architecture U-Net, qui combine un réseau d'encodage et de décodage pour capturer des caractéristiques détaillées pixel à pixel et permettre une génération d'images de haute qualité.

- Traduction d'image à image non supervisée (UNIT). Le modèle UNIT se concentre sur la traduction d'images non supervisée et vise à apprendre la cartographie entre différents domaines d'images sans un ensemble de données d'apprentissage appariées. UNIT utilise une architecture de type auto encodeur U-Net et introduit une nouvelle fonction de perte qui encourage la préservation des représentations du contenu pendant la traduction. Cette approche permet au modèle de générer des images visuellement attrayantes et sémantiquement cohérentes dans différents domaines.

La traduction d'image à image est une technologie d'IA générative populaire. Découvrez les huit principaux problèmes éthiques liés à l'IA générative.