VMworld 2009 : la tête toujours dans le nuage

Paul Maritz, PDG de VMware continue d’avoir la tête dans les nuages. Pas de manière fantasque mais plutôt pragmatique : le Cloud computing apparaît comme une opportunité de plus pour le spécialiste de la virtualisation, à moins que ce soit l'inverse. Du moins c'est ce que s’est efforcé de marteler Paul Maritz, en ouverture de sa grand messe cannoise, devant un public pas toujours sorti de la brume.

C’est avant tout une vision. Celle qui vise à faire de l’IT, un service, « pour plus d’efficacité, de contrôle et de choix ». Cette vision, du côté de l’infrastructure et du centre de calcul, Paul Maritz, PDG de VMware, la traduit en un mot : vSphere. Il s'agit en fait du nouveau nom donné par VMware à son offre d'hypervision construite autour du noyau ESX Server. cette nouvelle marque doit regrouper « toute notre nouvelle génération de produits pour la virtualisation de l’infrastructure ». vSphere est organisé en différente couches logicielles de virtualisation (notamment vcompute pour la virtualisation du matériel, vstorage pour la gestion du stockage, vnetwork pour la gestion du réseau) et fournit des services de disponibilité (HA et clustering) et de sécurité (via notamment vSafe).

vSphere est la première concrétisation de l'initiative de VMware pour développer ce qu'il appel un OS virtuel pour les datacenters (VDC-OS), une initiative pour la première fois été présentée par VMware lors de VMworld à Las Vegas en septembre dernier. il sera épaulé par une refonte de l'actuelle offre d'administration de la firme, baptisée vCenter (ex virtual Center) censée fournir les services habituels de création et d'administration de machines virtuelles, de gestion des capacités, des configurations et de la production. Mais vCenter fournira aussi des capacité de self-service, pour les utilisateurs métiers, ainsi que des informations de calcul d'unités d'oeuvres et de facturation. Voici qui devrait faciliter la tâche à VMware pour une seconde initiative présentée par Maritz et baptisée... vCloud (ça ne s'invente pas; avec humour, le PDG de l'éditeur s'amuse d'ailleurs à revendiquer un "droit divin sur la lettre 'v'").

vCloud a pour objectif de répondre aux entreprises qui ont fait « le choix du nuage » ou de la « fédération de nuages » -, entendez par là, qu'elles ont besoin d'agréger des ressources situé à la fois dans leurs datacenters (nuage interne) et hors de leurs datacenters (nuage externe). Enfin VMware a fait le point sur son initiative de virtualisation des postes de travail désormais baptisée vClient (ex-VDI).

Vers un mainframe logiciel

Dans son intervention, Paul Maritz a comparé vSphere à un mainframe purement logiciel dont les ressources matérielles pourraient évoluer dynamiquement : « dans les centres de calculs, la virtualisation des serveurs a d’abord servi à relever les niveaux d’utilisation, mais maintenant il s’agit de faire coopérer des serveurs entre eux, jusqu’à faire coopérer les hyperviseurs. » La dimension logicielle du mainframe virtuel de Paul Maritz devant permettre d’en assurer « la mise à l’échelle et la disponibilité ». Une vision qui n'est pas sans rappeler celle d'un certain Cisco avec sa future gamme « California ». Au-dessus de tout cela, le PDG de VMware veut « injecter plus d’intelligence : sécurité, conformité, puis administration, niveaux de service, » et bien sûr les applications, d’un nouveau genre, adaptées à ce modèle, mais aussi les anciennes, que l’on veut traiter comme des « boîtes noires », sans avoir à les réécrire – en s’appuyant sur vApp.

Paul Maritz, PDG de VMWare, présente vSphere

envoyé par LeMagIT

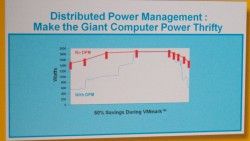

VDC-OS doit être modulaire, avec, notamment, des API ouvertes pour encourager les tiers à venir de greffer sur l’ensemble. D'un point de vue technique, il doit supporte des machines virtuelles jusqu'à 8 CPUs virtuels, 256 Go de mémoire vive et 40 Gbps de bande passante réseau. Sa fonction DRS - Distributed Ressource Scheduler - doit assurer l'équilibrage automatique de charge entre machines virtuels. Un dispositif auquel s'ajoute DPM - Distributed Power Management -, une fonction qui doit assurer le déplacement des machines virtuelles sur un nombre restreint de serveurs physiques en cas de baisse de charge, afin de permettre l'arrêt des machines physiques délestées pour en économiser la consommation électrique.

VDC-OS doit être modulaire, avec, notamment, des API ouvertes pour encourager les tiers à venir de greffer sur l’ensemble. D'un point de vue technique, il doit supporte des machines virtuelles jusqu'à 8 CPUs virtuels, 256 Go de mémoire vive et 40 Gbps de bande passante réseau. Sa fonction DRS - Distributed Ressource Scheduler - doit assurer l'équilibrage automatique de charge entre machines virtuels. Un dispositif auquel s'ajoute DPM - Distributed Power Management -, une fonction qui doit assurer le déplacement des machines virtuelles sur un nombre restreint de serveurs physiques en cas de baisse de charge, afin de permettre l'arrêt des machines physiques délestées pour en économiser la consommation électrique.

Côté administration, vCenter doit lui-même être extensible et fédérable. Déjà, avec le Linked Mode, VI Client peut supporter jusqu'à dix vCenter Servers, avec une fonction de recherche pour simplifier l'accès aux machines virtuelles gérées. Un plug-in pour vCenter doit permettre d'accéder directement à des nuages internes ou externes.

Un monde vraiment ouvert ?

Bien conscient que la domination actuelle de VMware sur le marché de la virtualisation peut susciter de nombreuses questions, Paul Maritz ouvre immédiatement un contre-feu : « pour que la fédération en nuages internes et externes soit possible, il faut des standards. Nous y travaillerons dès cette année. Il faut éviter les nuages propriétaires où l’on peut entrer mais dont on ne peut pas sortir, » explique-t-il presque pieusement, faisant au passage une analogie avec un certain Hotel California (humour sans doute générationnel : Hotel California est une chanson du groupe Eagles, sortie en 1977, qui décrit un hôtel dans lequel on peut faire son check-out mais qu'on ne peut jamais quitter, NDLR). Défendant un écosystème large et spécialisé, multi-couche, Paul Maritz a laissé à la place à trois démonstrations de solutions commerciales de type IT as a service, conçues sur les outils existants de VMware, allant de l’augmentation de ressources de calcul sur une grappe virtuelle à la mise à disposition automatisée d’un environnement Ruby on Rails clés en main.

Un calendrier encore flou

Quant à la concrétisation des ambitions de la firme en matière de cloud… Elle prendra du temps, confesse Lionel Cavalliere, directeur marketing produit senior de VMware pour la région EMEA. De nombreuses questions techniques restent à résoudre, à commencer, par exemple, par la gestion de la migration sans couture d’une machine virtuelle entre deux sites distants. Et cela ne s’arrête pas là : il faut également tenir compte, dans les schémas de réplication ou de continuité de l’activité, des réglementations locales sur la circulation des données – « on doit s’assurer que les politiques de gestion des données suivent les données, » relève Paul Maritz qui reconnaît néanmoins que « tous les traitements ne pourront pas aller dans le Cloud. » Sans compter, encore, le besoin de revoir certaines politiques tarifaires, basées sur le nombre de processeurs.

Quant à la concrétisation des ambitions de la firme en matière de cloud… Elle prendra du temps, confesse Lionel Cavalliere, directeur marketing produit senior de VMware pour la région EMEA. De nombreuses questions techniques restent à résoudre, à commencer, par exemple, par la gestion de la migration sans couture d’une machine virtuelle entre deux sites distants. Et cela ne s’arrête pas là : il faut également tenir compte, dans les schémas de réplication ou de continuité de l’activité, des réglementations locales sur la circulation des données – « on doit s’assurer que les politiques de gestion des données suivent les données, » relève Paul Maritz qui reconnaît néanmoins que « tous les traitements ne pourront pas aller dans le Cloud. » Sans compter, encore, le besoin de revoir certaines politiques tarifaires, basées sur le nombre de processeurs.

Bref, c’est élégant sur le papier mais c’est moins évident dans la pratique, avec des défis tels que la migration de machines virtuelles sur une longue distance; migration qui implique le déplacement de la mémoire, des images disques et le maintien de la connexion réseau. Cette migration fonctionnerait à l'état de prototype chez quelques clients testeurs de VMware, sans que le problème ne soit pour autant définitivement réglé. Paul Martiz l’assume pleinement : « c’est un long voyage et nous n’en sommes qu’au début. » Et, si VMware ne peut pas indiquer de date précise, l’éditeur avance néanmoins que les premiers pans de l'offre vSphere et vCenter arriveront « courant 2009 ». Pour sa bonne santé, VMware a sans doute tout intérêt à ce que ce soit plutôt au premier semestre qu'au second. à partir d'octobre il devra en effet faire face à une nouvelle mouture d'Hyper-V bien plus complète et robuste en terme de disponibilité que l'actuelle.

En attendant, l’éditeur ne laisse pas son auditoire sans nouveauté et il pallie l'une des principales faiblesses de son offre actuelle, l'impossibilité de clusteriser efficacement sa console vCenter. vCenter Server Heartbeat est un outil qui « surveille et gère automatiquement les défaillances de VMware vCenter Server » et répliquant sa configuration dans un serveur de secours passif afin d'assurer un failover rapide et transparent en cas de défaillance du serveur principal; une solution animée par la technologie de Neverfail et facturée près de 10 000 $ par serveur vCenter protégé. En clair, comptez 20 000$ pour une console redondante, contre un peu moins de 5000$ pour la console actuelle. C'est mieux... mais c'est indéniablement plus cher.