Qu'est-ce que la régression linéaire ?

La régression linéaire est une technique statistique qui identifie la relation entre la valeur moyenne d'une variable et les valeurs correspondantes d'une ou plusieurs autres variables. En comprenant la relation entre les variables, la technique de régression linéaire peut aider les data scientists à modéliser et à prédire comment une variable changera par rapport à une autre. Il peut s'agir d'analyses telles que l'estimation des ventes sur la base des prix des produits ou la prévision du rendement des cultures sur la base des précipitations. À la base, le terme régression signifie revenir à un état antérieur ou moins développé.

La régression linéaire dans l'apprentissage machine (ML) s'appuie sur ce concept fondamental pour modéliser la relation entre les variables en utilisant diverses techniques de ML pour générer une ligne de régression entre des variables telles que le taux de vente et les dépenses de marketing. Dans la pratique, l'apprentissage automatique tend à être plus utile lorsqu'il s'agit de travailler avec des variables multiples, appelées régression multivariée, où les relations entre les variables nécessitent des coefficients de régression plus complexes.

La régression linéaire est un élément de base de l'apprentissage supervisé. À la base, elle permet de déterminer si une variable explicative peut contribuer à prédire le résultat d'une autre variable. Par exemple, les dépenses publicitaires sur un support ou un autre ont-elles un impact significatif sur les ventes ?

Dans le cas le plus simple, la régression linéaire tente de prédire la valeur d'une variable, appelée variable dépendante, en fonction d'une autre variable, appelée variable indépendante. Par exemple, si une organisation tente de prédire le taux de vente en fonction des dépenses publicitaires, les ventes seraient la variable dépendante, tandis que les dépenses publicitaires seraient la variable indépendante.

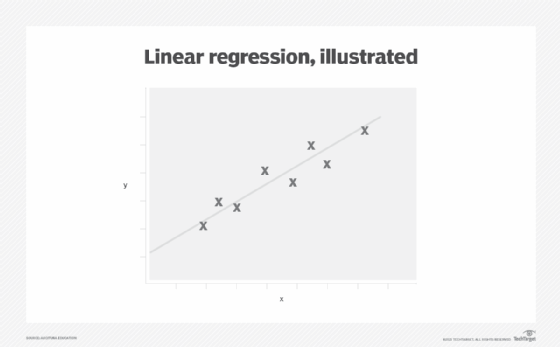

La régression linéaire est linéaire en ce sens qu'elle guide le développement d'une fonction ou d'un modèle qui s'adapte à une ligne droite - appelée ligne de régression linéaire - sur un graphique des données. Cette ligne minimise également la différence entre une valeur prédite pour la variable dépendante et la variable indépendante correspondante.

Dans le cas de l'estimation du taux de vente, chaque dollar de vente peut augmenter régulièrement dans une certaine fourchette pour chaque dollar dépensé en publicité, puis ralentir une fois que le marché publicitaire atteint un point de saturation. Dans ce cas, des fonctions plus complexes doivent être construites à l'aide de statistiques ou de techniques de ML pour ajuster les données à une ligne droite.

Pourquoi la régression linéaire est-elle importante ?

La régression linéaire est importante pour les raisons suivantes :

- Il fonctionne avec des données non étiquetées.

- C'est relativement simple et rapide.

- Il peut être utilisé comme un élément fondamental dans le monde des affaires et de la science.

- Il prend en charge l'analyse prédictive.

- Elle s'applique facilement aux modèles ML.

Types de régression linéaire

Il existe trois types principaux de régression linéaire :

- Régression linéaire simple. La régression linéaire simple est une fonction qui fait correspondre les points de données à une ligne droite sur un graphique de deux variables.

- Régression linéaire multiple. La régression linéaire multiple est une fonction qui fait correspondre des points de données à une ligne droite entre une variable dépendante, comme les ventes de crèmes glacées, et une fonction de deux variables indépendantes ou plus, comme la température et les dépenses publicitaires.

- Régression non linéaire. La régression non linéaire permet de trouver une fonction qui ajuste deux variables ou plus sur une courbe plutôt que sur une ligne droite.

Au-delà de ces trois catégories fondamentales, il existe de nombreuses méthodes de régression linéaire spécifiques, dont les suivantes :

- Modélisation linéaire hiérarchique (HLM).

- Régression Lasso.

- Régression logistique.

- Régression ordinale.

- Moindres carrés ordinaires.

- Régression par moindres carrés partiels.

- Régression polynomiale.

- Régression en composantes principales.

- Régression par quantile.

- Régression de crête.

- Modélisation des équations structurelles.

- Régression Tobit.

Chaque approche spécifique peut être appliquée à différentes tâches ou objectifs d'analyse de données. Par exemple, le modèle HLM (également appelé modélisation multiniveaux) est un type de modèle linéaire destiné à traiter des structures de données imbriquées ou hiérarchiques, tandis que la régression ridge peut être utilisée lorsqu'il existe une forte corrélation entre les variables indépendantes, ce qui pourrait entraîner des biais involontaires en utilisant d'autres méthodes.

Exemples de régression linéaire

Les paragraphes suivants mettent en évidence trois façons courantes d'utiliser la régression linéaire :

- Elle peut être utilisée pour identifier l'ampleur de l'effet qu'une variable indépendante, comme la température, peut avoir sur une variable dépendante, comme les ventes de crème glacée.

- Elle peut être utilisée pour prévoir l'impact des changements induits par la variable indépendante - par exemple, combien de crèmes glacées supplémentaires pourraient être vendues avec différents niveaux de publicité.

- Elle peut être utilisée pour prédire des tendances et des valeurs futures - comme la quantité de crème glacée à stocker pour répondre à la demande si l'on prévoit que la température atteindra 90 degrés Fahrenheit.

Cas d'utilisation de la régression linéaire

Les cas typiques d'utilisation de la régression linéaire en entreprise sont les suivants :

- L'élasticité des prix. De combien les ventes diminueront elles si le prix est augmenté d'un montant donné ?

- Gestion des risques. Quelle est la responsabilité anticipée pour une force de tempête donnée ?

- Contrats à terme sur les matières premières. Quelle est la relation entre les précipitations et le rendement des cultures ?

- Détection de la fraude. Quelle est la probabilité qu'une transaction soit frauduleuse ?

- Analyse d'entreprise. De combien les ventes pourraient-elles augmenter avec différents niveaux d'incitation à la participation aux bénéfices ?

Avantages et inconvénients de la régression linéaire

Les avantages de la régression linéaire sont les suivants :

- Il facilite l'analyse exploratoire des données.

- Il permet d'identifier les relations entre les variables.

- Il est relativement simple à mettre en œuvre.

Les inconvénients de la régression linéaire sont les suivants :

- Elle ne fonctionne pas bien si les données ne sont pas vraiment indépendantes.

- La régression linéaire ML est sujette à un sous-ajustement qui ne tient pas compte des événements rares.

- Les valeurs aberrantes peuvent fausser la précision des modèles de régression linéaire.

Hypothèses clés de la régression linéaire

La régression linéaire exige que l'ensemble des données présente les propriétés suivantes :

- Les données doivent être organisées sous forme de séries continues, telles que le temps, les ventes en dollars ou les dépenses publicitaires. La méthode ne fonctionne pas directement avec les données qui se présentent sous la forme de catégories telles que les jours de la semaine ou le type de produit. Les mesures doivent être effectuées de manière cohérente.

- La variable réponse forme une relation linéaire entre les paramètres et les variables prédictives. Les variables prédictives étant considérées comme des valeurs fixes, la linéarité consiste simplement à définir correctement les paramètres.

- Les observations doivent être réellement indépendantes les unes des autres. Par exemple, les ventes et les bénéfices peuvent ne pas être indépendants si le coût des marchandises ou d'autres facteurs n'affectent pas les bénéfices séparément.

- Les données doivent être nettoyées de toute aberration ou événement rare - problèmes de qualité des données.

- L'écart de chaque point de données par rapport à la ligne droite doit être constant en cas de variation de la variable indépendante. Cette variance constante est appelée homoscédasticité.

- Bien que les observations ou les points de données soient des valeurs aléatoires, les variables prédictives peuvent être traitées comme des valeurs fixes. C'est ce qu'on appelle l'exogénéité faible.

Outils de régression linéaire

Les méthodes de régression linéaire peuvent être exécutées sur papier, mais le processus peut être lourd et impliquer des sommes et des carrés répétitifs. Les applications professionnelles et d'enseignement supérieur des équations de régression linéaire utilisent généralement des applications logicielles pour ingérer des données et effectuer rapidement les processus mathématiques requis. La régression linéaire est prise en charge par de nombreux outils logiciels et bibliothèques de programmation, dont les suivants :

- Logiciels statistiques dédiés tels que IBM SPSS Statistics.

- Matlab.

- Microsoft Excel.

- Régression linéaire R.

- Scikit-learn.

Régression linéaire vs. régression logistique

La régression linéaire n'est qu'une catégorie de techniques de régression permettant d'ajuster des nombres sur un graphique.

La régression multivariée permet d'ajuster les données à une courbe ou à un plan dans un graphique multidimensionnel représentant les effets de plusieurs variables.

Bien que la régression logistique et la régression linéaire utilisent toutes deux des équations linéaires pour les prédictions, la régression logistique prédit si un point de données donné appartient à une classe ou à une autre, comme spam/pas de spam pour un filtre de courrier électronique ou fraude/pas de fraude pour un autorisateur de carte de crédit.

Apprenez ce qu'est l'apprentissage supervisé, non supervisé et semi-supervisé et comment les algorithmes d'apprentissage automatique sont utilisés dans diverses applications commerciales.